- 潜变量模型

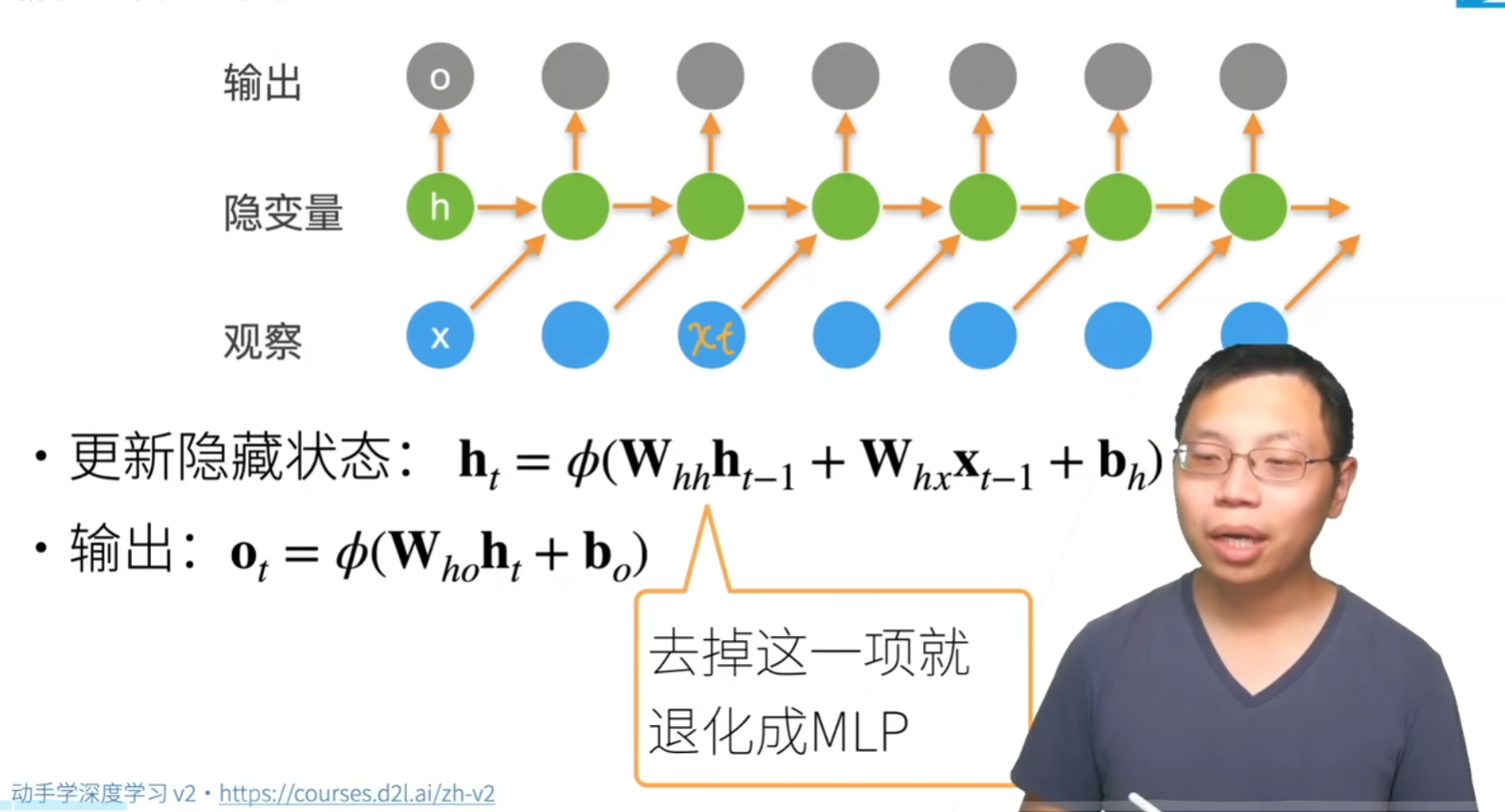

- RNN

- RNN

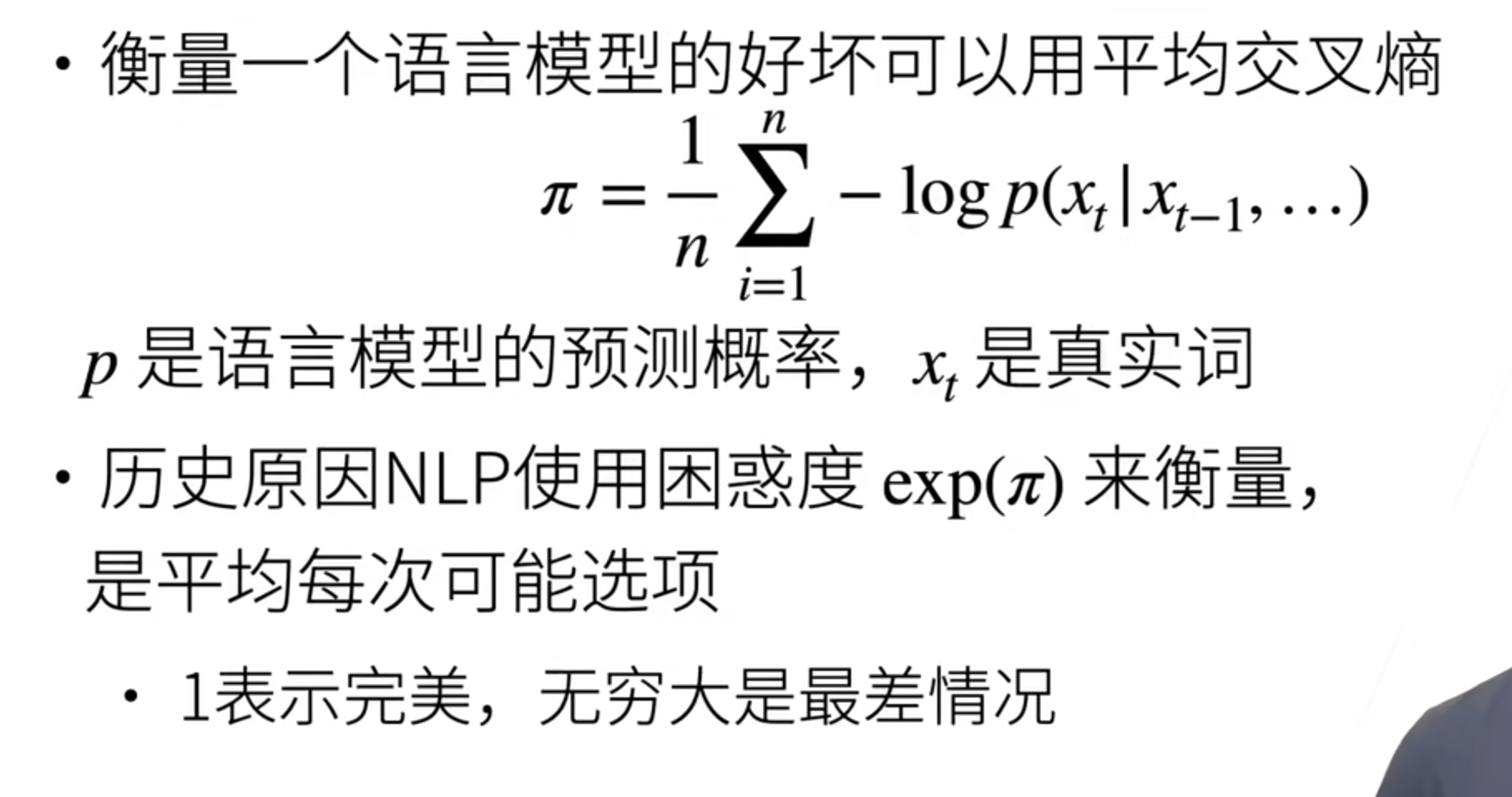

- 困惑度

- 实际就是交叉熵函数,只不过除以了n(n指的是时间步,因为对于序列模型不是只有一个输出,而是根据上一次的结果不停推断下一个词)

- 实际就是交叉熵函数,只不过除以了n(n指的是时间步,因为对于序列模型不是只有一个输出,而是根据上一次的结果不停推断下一个词)

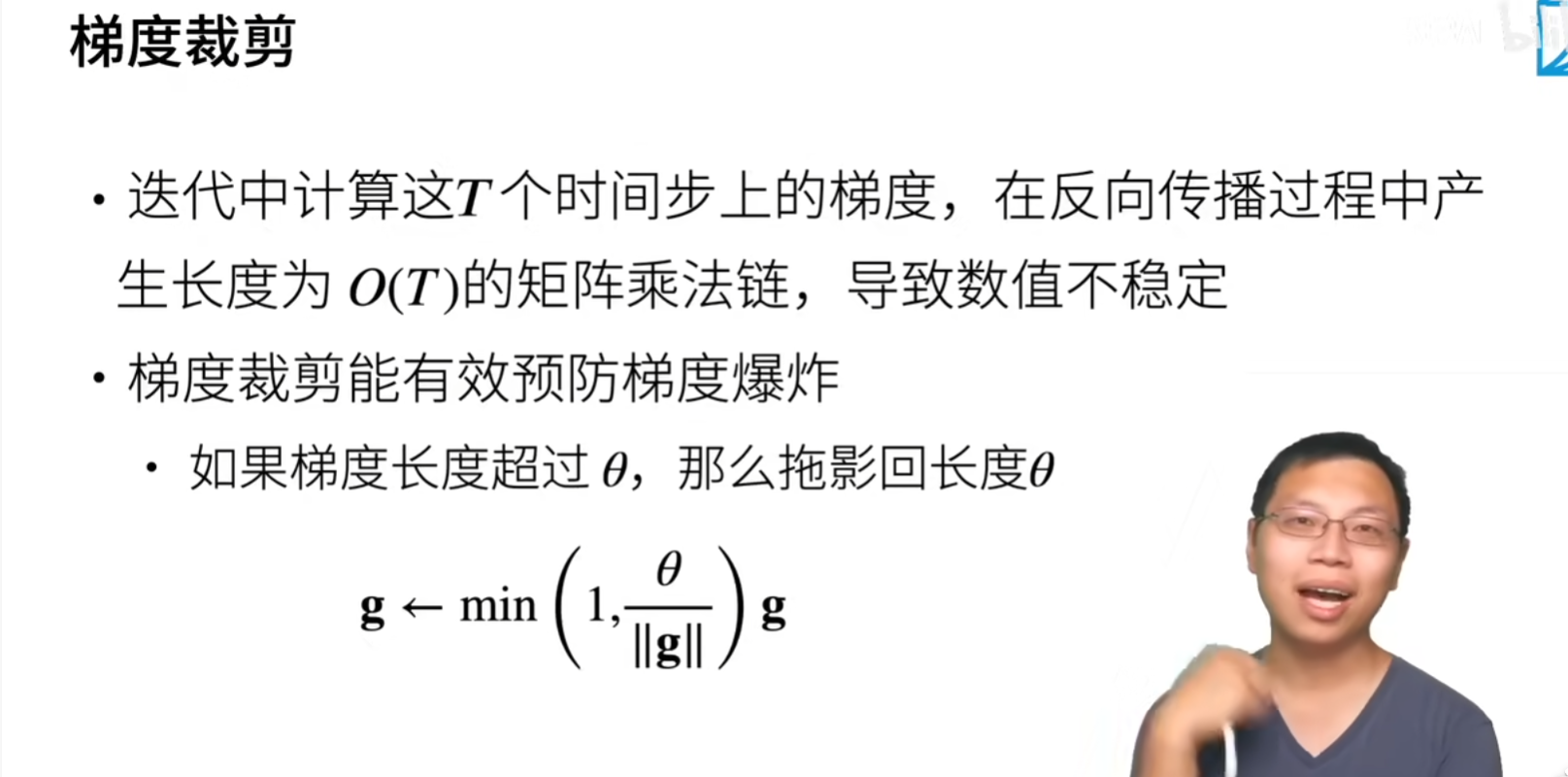

- 梯度裁剪

- 目的:防止梯度爆炸,相当于用L2正则化处理权重,对权重正则化

- 目的:防止梯度爆炸,相当于用L2正则化处理权重,对权重正则化

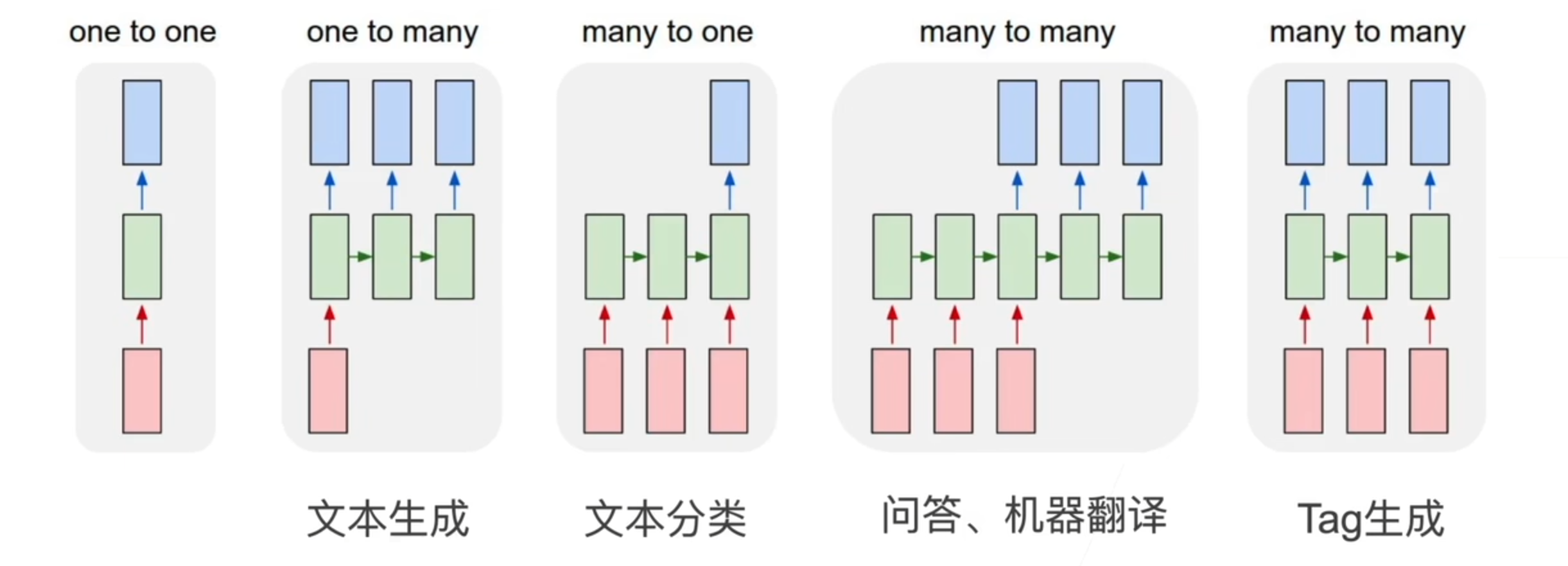

- RNN的应用

- 文本生成: 55 循环神经网络 RNN 的实现

- 文本分类:

- 机器翻译:62 序列到序列学习(seq2seq)